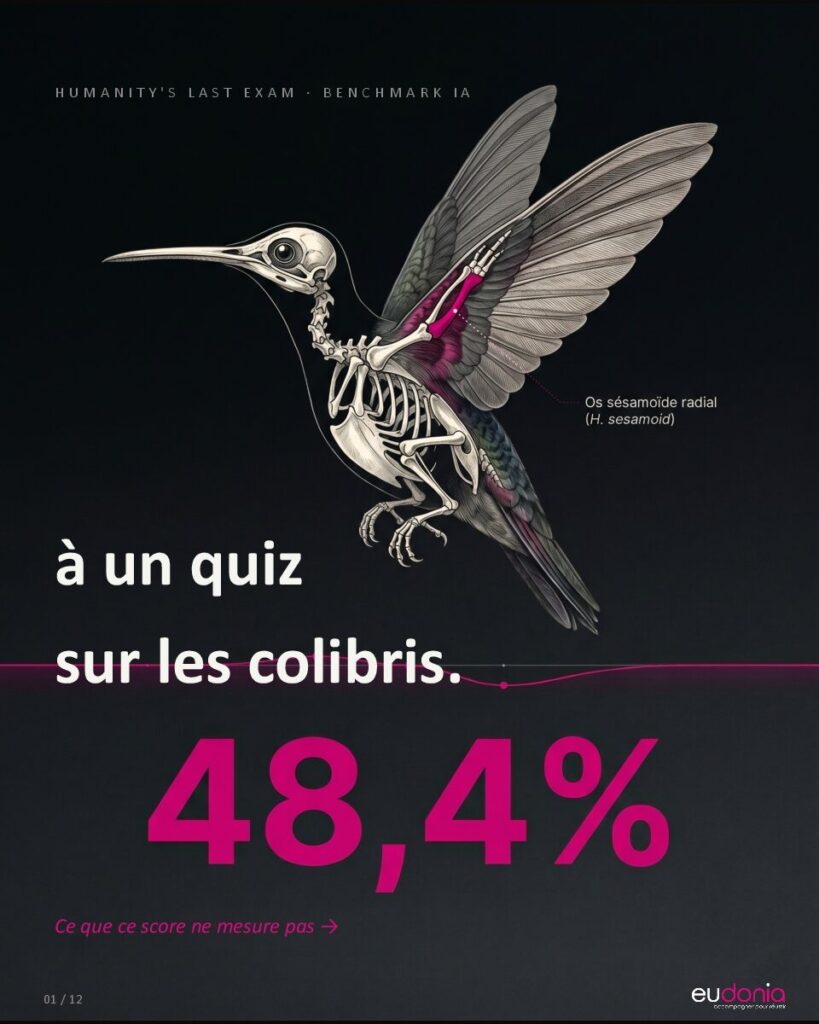

48,4% à un quiz sur les colibris.

Google annonce fièrement que son IA Gemini 3 Deep Think a explosé le record du test « Humanity’s Last Exam ». 48,4%.

C’est beau.

Sauf que, ce test est censé mesurer si une IA est prête à faire de la science. 2 500 questions « à la frontière de la connaissance humaine ».

Genre : combien de paires de tendons l’os sésamoïde d’un colibri soutient ?

Voilà.

Ou : combien de couleurs ont les allotropes du phosphore.

C’est Chenru Duan, le mec de Deep Principle, qui le dit lui-même : en quoi savoir ça aide qui que ce soit à découvrir quoi que ce soit ?

Mais OpenAI, Google, Anthropic, ils s’en fichent. Ce qui compte c’est le score. Le chiffre dans le communiqué de presse. La courbe qui monte sur le slide de la levée de fonds.

Petit rappel que la psychométrie connaît depuis les standards APA de 1954. Il existe deux types de validité.

Validité de contenu : le test couvre-t-il bien le domaine ? HLE est imbattable là-dessus.

Validité prédictive : les scores prédisent-ils la performance réelle ? Personne n’a jamais montré qu’un modèle à 48% découvre plus qu’un modèle à 8%.

Un test peut être impeccable sur le premier critère et complètement vide sur le second.

C’est le b.a.-ba de tout praticien qui manipule des instruments depuis vingt ans.

L’industrie de l’IA redécouvre ça en 2026, en public, avec 250 balles par mois pour l’abonnement Google AI Ultra.

Après tu as les sérieux. Ceux qui essaient de mesurer la VRAIE science.

OpenAI sort FrontierScience en décembre. GPT-5.2 cartonne à 77% sur les questions type Olympiades.

Et sur les vrais problèmes de recherche ouverts ? 25%. Vingt. Cinq. Pour cent. Le grand écart entre « je récite » et « je cherche ».

Et le pire c’est le benchmark SDE de Duan. Tu colles les meilleurs modèles d’OpenAI, d’Anthropic, de xAI, de DeepSeek sur de vrais projets de recherche.

Ils se plantent TOUS sur les mêmes questions difficiles. Probablement parce qu’ils ont bouffé la même soupe de données. Mêmes angles morts. Même plafond de verre.

Quatre boîtes qui se tirent la bourre, qui crament des milliards en GPU, et au final qui butent toutes sur les mêmes murs parce qu’elles ont lu les mêmes papiers.

Moi le premier, j’ai gobé les démos. J’ai cru au « PhD dans ta poche ». Sauf que ton PhD dans ta poche, mets-le devant LABBench2 de FutureHouse, demande-lui de croiser trois bases de données et d’aller chercher une figure planquée dans un papier dense. Il rame.

La vérité simple : tant qu’on mesurera la science avec des QCM de culture générale, on aura des IA championnes de QCM. Pas des chercheurs.

Ce qu’on mesure, c’est ce qui s’améliore. Le reste meurt.

__

Eudonia

eudonia . fr