Le 30 novembre 2022 restera gravé dans l’histoire comme le jour où l’humanité a franchi un seuil invisible. Ce jour-là, OpenAI a lancé ChatGPT, et le monde s’est précipité avec un enthousiasme délirant vers cette nouveauté technologique. « C’est génial ! » avons-nous tous pensé.

Trois ans plus tard, le tableau s’assombrit considérablement. Les intelligence artificielle générative dangers se révèlent progressivement, touchant des domaines que nous pensions protégés : l’emploi intellectuel, la créativité artistique, l’éducation, et même notre rapport à autrui.

Nous assistons à une transformation silencieuse mais profonde de notre société. Spotify compte désormais 30% de musiques générées par IA dans son catalogue. Des acteurs manifestent contre des « collègues » numériques tout en utilisant ChatGPT chez eux le soir. L’ironie est mordante, presque cruelle.

Cet article explore les risques méconnus des IA génératives, cette technologie qui nous fascine autant qu’elle nous menace. Nous analyserons pourquoi le problème n’est pas technique, mais fondamentalement moral et philosophique.

L’euphorie initiale : quand ChatGPT a conquis le monde

L’arrivée de ChatGPT a provoqué un phénomène rare dans l’histoire technologique : une adoption massive et quasi instantanée. En quelques jours, des millions d’utilisateurs se sont inscrits sur la plateforme d’OpenAI, testant avec émerveillement les capacités de cet assistant conversationnel.

Les réseaux sociaux ont explosé de démonstrations époustouflantes. Des développeurs montraient comment l’outil générait du code en quelques secondes. Des rédacteurs s’émerveillaient de sa capacité à produire des articles entiers. Des étudiants découvraient un nouveau compagnon d’études infiniment patient.

Cette euphorie collective masquait une réalité troublante : personne ne s’interrogeait vraiment sur les conséquences. L’enthousiasme technologique a balayé toute réflexion critique. Nous nous sommes comportés comme des enfants devant un distributeur de bonbons gratuit, sans nous demander quel prix nous allions réellement payer.

30 novembre 2022 : le jour où tout a basculé

Cette date marque un tournant historique dans notre relation avec la technologie. Pour la première fois, une intelligence artificielle générative devenait accessible gratuitement au grand public, sans barrière technique ni compétence particulière requise.

Avant ChatGPT, les IA étaient cantonnées aux laboratoires de recherche ou à des applications spécialisées. Le 30 novembre 2022, cette frontière s’est effondrée. N’importe qui pouvait désormais demander à une machine de rédiger un email, d’écrire une dissertation, de composer un poème ou même de coder une application.

La facilité d’utilisation a joué un rôle déterminant dans cette adoption fulgurante. Pas besoin de formation, pas de manuel d’utilisation complexe. Il suffisait de taper une question en langage naturel pour obtenir une réponse structurée et convaincante.

Cette accessibilité universelle a créé une dépendance quasi immédiate. Les utilisateurs ont rapidement intégré ChatGPT dans leur quotidien professionnel et personnel. En quelques semaines, l’outil était devenu indispensable pour des millions de personnes à travers le monde.

Mais cette adoption massive s’est faite sans débat public, sans réflexion collective sur les implications éthiques. Les gouvernements, dépassés par la vitesse du phénomène, n’ont pas eu le temps de réguler. Les institutions éducatives se sont retrouvées démunies face à des étudiants utilisant l’IA pour leurs devoirs.

Les conséquences invisibles trois ans après

Aujourd’hui, en 2025, nous commençons à mesurer l’ampleur des transformations induites par les IA génératives. Les effets, d’abord subtils et diffus, deviennent de plus en plus évidents et préoccupants.

L’une des premières victimes est la confiance dans les contenus que nous consommons. Comment distinguer un article écrit par un humain d’un texte généré par IA ? Cette incertitude permanente érode notre capacité à évaluer la qualité et l’authenticité des informations.

Les secteurs créatifs subissent une pression inédite. Les illustrateurs indépendants voient leurs commandes chuter drastiquement face à des outils comme Midjourney ou DALL-E qui produisent des visuels en quelques secondes. Les rédacteurs web se retrouvent en compétition avec des algorithmes capables de générer des centaines d’articles quotidiennement.

Plus inquiétant encore, nous observons une modification subtile mais réelle de nos comportements cognitifs. La tentation de déléguer à l’IA nos tâches intellectuelles devient irrésistible. Pourquoi chercher un mot précis quand ChatGPT peut reformuler notre phrase ? Pourquoi réfléchir à la structure d’un argumentaire quand l’outil le fait instantanément ?

Cette délégation progressive engendre une atrophie de nos facultés. Comme un muscle qui s’affaiblit faute d’exercice, notre capacité de réflexion, d’expression et de créativité s’amenuise progressivement. Nous perdons ce que les neuroscientifiques appellent la « plasticité cognitive » : notre cerveau s’adapte à ne plus fournir ces efforts devenus « inutiles ».

L’impact sur l’emploi et la créativité professionnelle

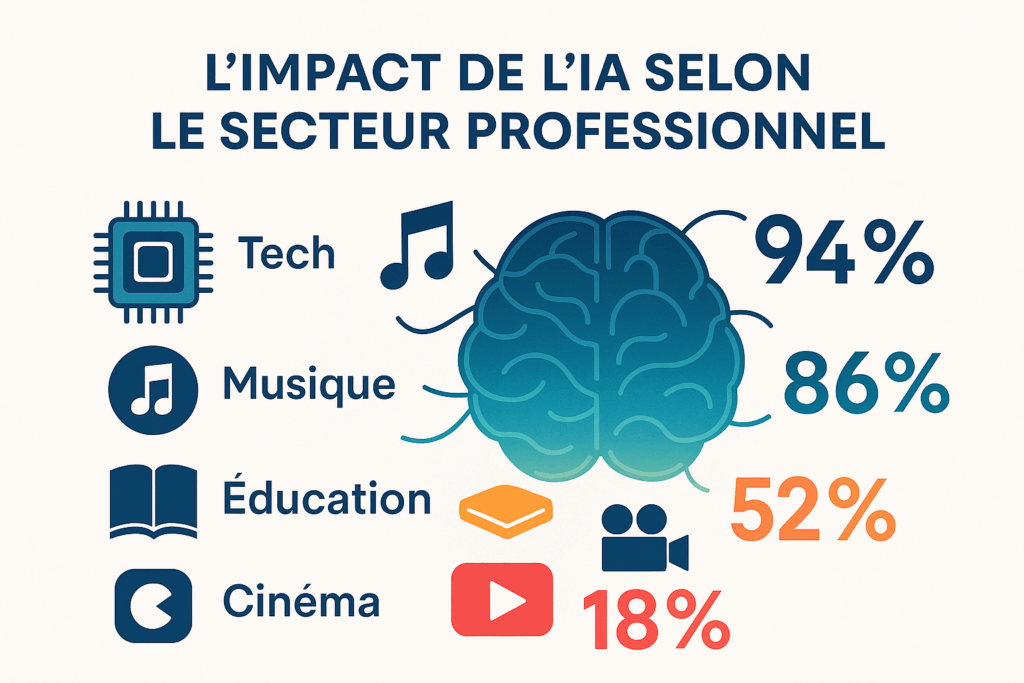

L’apocalypse annoncée dans certains secteurs n’est plus une hypothèse futuriste mais une réalité documentée. Les entreprises technologiques ont massivement réduit leurs effectifs, remplaçant des postes entiers par des outils d’IA générative.

Selon plusieurs études récentes, les métiers de la création de contenu sont particulièrement exposés. Les rédacteurs techniques, les traducteurs, les graphistes, les compositeurs de musique commerciale voient leurs perspectives professionnelles s’assombrir. Certains analystes estiment que 30 à 40% des emplois créatifs pourraient être automatisés d’ici 2030.

Le secteur musical illustre parfaitement cette transformation. Spotify révèle que près de 30% de sa bibliothèque provient désormais de compositions générées par IA. Ces morceaux, souvent utilisés comme musique d’ambiance ou de fond, coûtent infiniment moins cher que des créations humaines. Les artistes indépendants se retrouvent noyés dans ce flux incessant de productions automatisées.

L’industrie cinématographique n’est pas épargnée. Des acteurs manifestent contre l’utilisation d’avatars numériques créés par IA, capables de reproduire leur apparence et leur voix sans leur consentement. L’ironie veut que certains de ces manifestants utilisent eux-mêmes ChatGPT pour rédiger leurs discours ou gérer leurs réseaux sociaux.

Cette contradiction révèle notre ambivalence collective : nous dénonçons les dangers de l’IA tout en profitant de ses avantages pratiques. Cette schizophrénie morale caractérise notre époque.

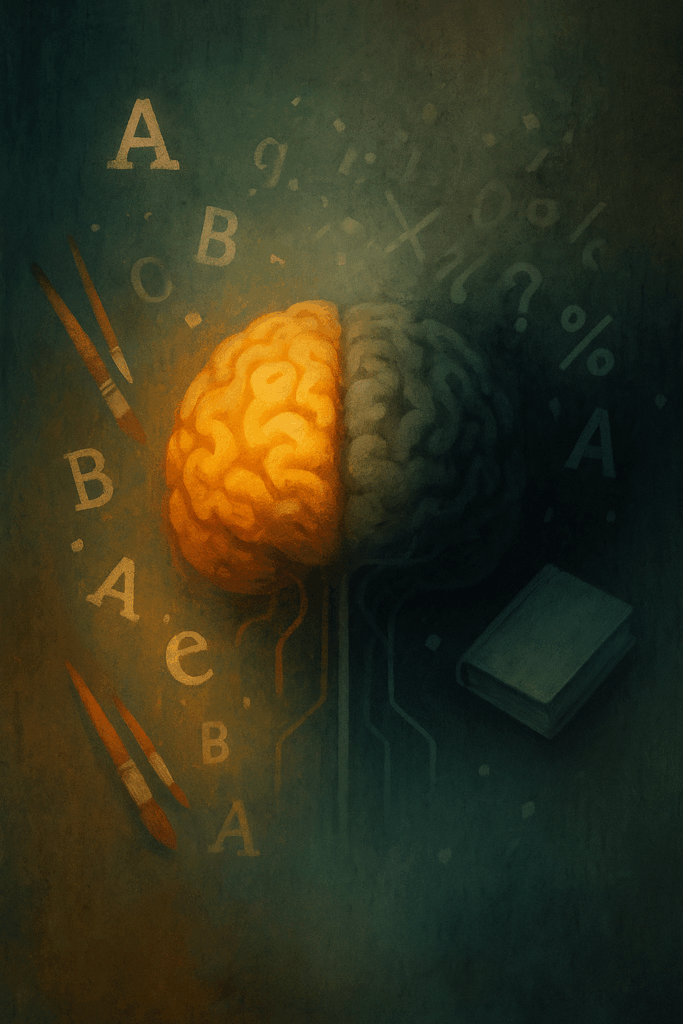

L’éducation face à la révolution IA

Le système éducatif traverse une crise existentielle sans précédent. Les enseignants se retrouvent confrontés à une question vertigineuse : pourquoi enseigner l’orthographe, la grammaire, la rédaction ou même les mathématiques si ChatGPT peut effectuer ces tâches instantanément ?

Les étudiants posent désormais ouvertement cette question à leurs professeurs. « Pourquoi devrais-je apprendre à écrire si l’IA peut le faire à ma place ? » Cette interrogation légitime déstabilise les fondements mêmes de notre système pédagogique.

Certains établissements tentent d’interdire l’utilisation des IA génératives, mais cette approche s’avère inefficace et même contre-productive. Les étudiants continuent d’utiliser ces outils en cachette, développant des stratégies de contournement de plus en plus sophistiquées. Les logiciels de détection de contenus générés par IA se révèlent peu fiables et produisent de nombreux faux positifs.

D’autres institutions adoptent l’approche inverse : intégrer l’IA dans les méthodes d’enseignement. Mais cette voie soulève de nouvelles questions. Si les élèves apprennent avec l’aide constante de l’IA, développeront-ils vraiment des compétences autonomes ? Ne risquent-ils pas de devenir dépendants de ces béquilles technologiques ?

L’enjeu dépasse largement la simple question de la triche académique. Il s’agit de déterminer quelles compétences fondamentales doivent être préservées à l’ère de l’automatisation intellectuelle. La mémorisation, la concentration, la capacité d’analyse critique, la construction d’un raisonnement original : ces facultés risquent de s’atrophier si nous déléguons systématiquement à l’IA nos tâches cognitives.

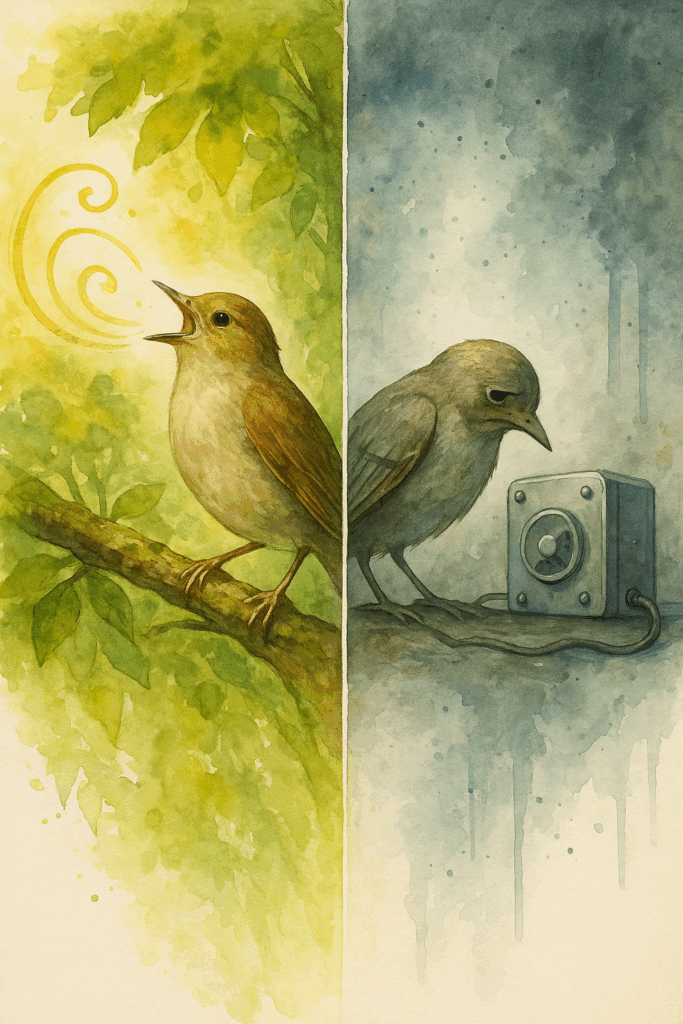

La fable du rossignol philomène : comprendre l’atrophie créative

Une ancienne fable, rarement évoquée dans le débat sur l’IA, offre pourtant une métaphore saisissante de notre situation actuelle. Elle raconte l’histoire du rossignol philomène, un oiseau réputé pour son chant extraordinairement complexe et créatif.

Ce rossignol possédait un don exceptionnel : la capacité de générer des mélodies infiniment variées, de composer des harmonies nouvelles chaque jour. Son talent faisait l’admiration de toute la forêt. Les autres oiseaux venaient de loin pour écouter ses concerts improvisés.

Un jour, un inventeur proposa au rossignol un appareil merveilleux. Cette machine pouvait analyser ses compositions et générer automatiquement de nouveaux chants encore plus élaborés. « Tu seras libéré de l’effort créatif », promettait l’inventeur. « Plus besoin de chercher, d’expérimenter, de te tromper. La machine fera tout cela pour toi. »

Séduit par cette perspective, le rossignol accepta. Au début, il fut enchanté. L’appareil produisait effectivement des mélodies magnifiques sans qu’il ait à fournir le moindre effort. Il pouvait passer ses journées à se reposer pendant que la machine chantait à sa place.

Mais progressivement, quelque chose d’inquiétant se produisit. Le rossignol perdit l’envie de chanter par lui-même. Ses cordes vocales s’affaiblirent faute d’usage. Sa créativité naturelle s’éteignit peu à peu. Il ne savait plus improviser, ne trouvait plus d’inspiration. Ses propres compositions lui semblaient désormais ternes et maladroites comparées aux productions de la machine.

Le rossignol devint triste et solitaire. Il avait gagné en facilité mais perdu son essence même. Les autres oiseaux ne venaient plus l’écouter, car ils percevaient que la magie avait disparu. Les chants de la machine, bien que techniquement parfaits, manquaient de l’âme qui caractérisait les créations originales du rossignol.

Cette fable illustre parfaitement le piège dans lequel nous sommes en train de tomber collectivement. Les IA génératives nous promettent l’efficacité et la facilité, mais elles menacent d’atrophier nos capacités créatives les plus précieuses.

Le problème moral derrière la révolution technologique

La véritable question concernant les IA génératives n’est pas « Peuvent-elles faire ceci ou cela ? » mais plutôt « Devrions-nous les laisser le faire ? » Cette interrogation morale fondamentale a été complètement évacuée du débat public lors du déploiement de ChatGPT et de ses concurrents.

Nous avons collectivement failli sur le plan éthique. Face à une technologie aussi puissante et transformatrice, nous aurions dû organiser un débat démocratique approfondi avant son adoption massive. Nous aurions dû nous demander : quelles sont les limites acceptables ? Quels usages autoriser et lesquels proscrire ?

Au lieu de cela, nous avons laissé quelques entreprises technologiques privées décider seules de l’orientation de cette révolution. OpenAI, Google, Anthropic et d’autres ont développé et déployé des outils qui transforment radicalement notre rapport au langage, à la créativité et au savoir, sans véritable consultation publique.

Cette faillite collective s’explique en partie par la vitesse du phénomène. L’adoption de ChatGPT a été si rapide que les instances de régulation, les gouvernements et même les chercheurs en éthique n’ont pas eu le temps de réagir. Nous avons été pris de vitesse par notre propre enthousiasme technologique.

Mais cette excuse ne tient plus aujourd’hui. Trois ans après le lancement de ChatGPT, nous avons suffisamment de recul pour évaluer les dégâts et poser les vraies questions. La dimension morale du problème peut se résumer ainsi : avons-nous le droit de créer des outils qui risquent d’atrophier nos facultés humaines les plus essentielles ?

Car c’est bien de cela qu’il s’agit. Les intelligence artificielle générative dangers ne se limitent pas à la question économique du remplacement des emplois. Ils touchent à notre essence même en tant qu’êtres pensants et créatifs.

L’évacuation d’autrui et l’isolement programmé

L’un des aspects les plus insidieux des IA génératives réside dans leur capacité à se substituer aux relations humaines dans de nombreux domaines professionnels et créatifs. Cette substitution progressive engendre ce qu’on pourrait appeler « l’évacuation d’autrui » de nos vies.

Réfléchissons un instant aux interactions que les IA génératives remplacent. Lorsque nous sollicitons ChatGPT pour rédiger un email, nous renonçons à l’exercice de formuler nous-mêmes notre pensée. Lorsque nous utilisons une IA pour créer un visuel, nous évitons de collaborer avec un graphiste humain. Lorsque nous demandons à un algorithme de composer de la musique, nous nous privons de l’échange avec un musicien.

Chacune de ces délégations semble anodine prise individuellement. Mais leur accumulation produit un effet systémique préoccupant : nous avons de moins en moins besoin des autres pour accomplir nos tâches intellectuelles et créatives. Les « super assistants » IA qui se développent actuellement promettent d’aller encore plus loin dans cette direction.

Imaginons un monde où vous pourriez solliciter votre assistant IA personnel pour : concevoir votre maison sans architecte, rédiger vos contrats sans avocat, créer vos supports pédagogiques sans enseignant, composer votre musique sans musicien, illustrer vos projets sans artiste. Ce monde n’est pas de la science-fiction : il se construit méthodiquement sous nos yeux.

Les conséquences psychologiques et sociales de cette évolution sont potentiellement dévastatrices. L’être humain est fondamentalement un animal social. Nos interactions avec autrui ne servent pas seulement à accomplir des tâches : elles structurent notre identité, nourrissent notre créativité, développent notre empathie.

Lorsque nous travaillons avec d’autres humains, nous apprenons à négocier, à comprendre des perspectives différentes, à adapter notre communication, à gérer les désaccords. Ces compétences sociales s’acquièrent uniquement par la pratique. Si nous remplaçons systématiquement ces interactions par des échanges avec des IA, nous nous condamnons à une forme d’infantilisation sociale.

La perte de notre singularité humaine

Chaque être humain possède une voix unique, une manière personnelle de s’exprimer qui reflète son histoire, sa culture, sa sensibilité. Cette singularité constitue un trésor irremplaçable, le fondement même de notre identité.

Les IA génératives, par leur nature même, tendent vers l’uniformisation. ChatGPT produit des textes techniquement corrects mais dépourvus de cette touche personnelle qui fait qu’on reconnaît un auteur. Midjourney génère des images esthétiques mais formatées selon des canons prédéfinis. Ces outils excellent dans l’imitation et la combinaison, mais peinent à créer quelque chose de véritablement original.

Le danger réside dans la tentation croissante de conformer notre propre expression à celle des IA. Combien d’utilisateurs demandent à ChatGPT de « reformuler » leur texte, perdant au passage leur style personnel ? Combien d’artistes s’inspirent tellement des productions d’IA qu’ils finissent par adopter inconsciemment leurs codes visuels ?

Cette convergence vers une expression standardisée appauvrit considérablement notre paysage culturel. La diversité des voix, des styles, des approches créatives constitue la richesse de notre civilisation. Si nous laissons les IA générer une part croissante de nos contenus, nous risquons d’aboutir à une forme d’homogénéisation culturelle sans précédent.

Plus grave encore, l’utilisation intensive des IA génératives peut nous faire douter de la valeur de notre propre expression. Pourquoi partager mon texte imparfait alors que ChatGPT pourrait produire quelque chose de plus « professionnel » ? Cette insécurité linguistique et créative pousse de nombreuses personnes à s’effacer derrière les productions algorithmiques.

Nous assistons ainsi à une forme paradoxale d’autocensure : nous possédons les moyens techniques de nous exprimer plus facilement que jamais (réseaux sociaux, blogs, plateformes de publication), mais nous déléguons cette expression à des machines qui parlent à notre place avec une voix qui n’est pas la nôtre.

Ce que nous perdons avec les IA génératives

L’inventaire de ce que nous risquons de perdre avec l’adoption massive des IA génératives dépasse largement les seules considérations économiques ou professionnelles. Il touche aux fondements mêmes de ce qui fait de nous des êtres humains pensants et créatifs.

D’abord, nous perdons la maîtrise progressive de notre langage. Le langage n’est pas un simple outil de communication : il structure notre pensée, il organise notre rapport au monde, il construit notre identité sociale. Lorsque nous déléguons à une IA la formulation de nos idées, nous nous privons de cet exercice fondamental qui affine notre capacité de réflexion.

Les neurosciences cognitives ont démontré que l’acte d’écrire ou de reformuler une idée active des zones cérébrales impliquées dans la mémorisation, la compréhension profonde et la créativité. En court-circuitant ce processus par l’utilisation d’IA rédactionnelles, nous nous privons de ces bénéfices cognitifs essentiels.

Ensuite, nous perdons notre capacité de concentration soutenue. La génération instantanée de contenus par l’IA nous habitue à l’immédiateté et à la facilité. Cette habitude érode progressivement notre tolérance à l’effort intellectuel prolongé. Pourquoi passer des heures à élaborer un raisonnement complexe quand ChatGPT peut le faire en quelques secondes ?

Cette perte de concentration a des répercussions sur notre vie intellectuelle globale. La lecture approfondie, la réflexion méthodique, l’analyse critique : toutes ces activités exigent une capacité de concentration que nous risquons de voir s’affaiblir.

Nous perdons également notre tolérance à l’imperfection et à l’erreur. Les productions d’IA sont généralement « lisses », techniquement correctes, exemptes des maladresses qui caractérisent souvent les créations humaines. Cette perfection apparente crée un standard irréaliste qui dévalorise nos propres productions imparfaites.

Or, l’erreur et l’imperfection jouent un rôle crucial dans l’apprentissage et la créativité. C’est en se trompant, en recommençant, en ajustant qu’on développe véritablement ses compétences. Si nous nous habituons à des résultats « parfaits » dès la première tentative grâce à l’IA, nous perdons cette dynamique d’apprentissage par essai-erreur.

Langage, expression et identité

Le rapport entre langage et identité constitue l’un des enjeux les plus profonds soulevés par les IA génératives. Notre façon de parler, d’écrire, de nous exprimer ne se limite pas à transmettre des informations : elle révèle qui nous sommes, d’où nous venons, ce qui nous anime.

Lorsque nous écrivons nous-mêmes, nous faisons des choix – conscients ou inconscients – qui reflètent notre personnalité. Le vocabulaire que nous employons, la structure de nos phrases, les images que nous convoquons : tout cela constitue notre signature linguistique unique. Cette singularité s’acquiert par des années de pratique, d’expérimentation, de lectures et d’échanges.

Les IA génératives, aussi performantes soient-elles, ne peuvent reproduire cette authenticité. Elles excellent à imiter des styles existants, à combiner des patterns linguistiques, à générer des textes fonctionnels. Mais elles ne peuvent pas infuser dans leurs productions cette dimension subjective qui fait qu’un texte « sonne » comme son auteur.

Le risque majeur réside dans l’abandon progressif de notre propre voix au profit de celle, standardisée, des algorithmes. Chaque fois que nous demandons à ChatGPT de « reformuler » notre texte pour le rendre « plus professionnel » ou « plus clair », nous sacrifions un peu de notre singularité sur l’autel de l’efficacité.

Cette perte n’est pas anodine. Notre identité linguistique se construit tout au long de notre vie. Elle témoigne de notre parcours éducatif, de nos influences culturelles, de nos expériences personnelles. En la déléguant à des machines, nous nous appauvrissons nous-mêmes.

De plus, la maîtrise du langage structure notre rapport au réel. Savoir nommer précisément nos émotions, décrire avec justesse une situation, articuler clairement un raisonnement : ces compétences ne servent pas seulement à communiquer avec autrui, elles nous permettent de mieux comprendre notre propre expérience du monde.

Si nous perdons l’habitude de formuler nous-mêmes nos pensées, nous risquons également de perdre cette capacité d’introspection et d’analyse qui nous permet de donner du sens à notre existence. Le langage n’est pas qu’un outil : c’est le médium même de notre conscience réflexive.

Faut-il interdire les IA génératives ?

Cette question peut sembler radicale, voire irréaliste. Comment interdire une technologie déjà adoptée par des centaines de millions d’utilisateurs à travers le monde ? Comment faire marche arrière alors que les IA génératives sont désormais intégrées dans d’innombrables services et applications ?

Pourtant, cette interrogation mérite d’être posée sérieusement. L’histoire nous enseigne que certaines technologies, initialement accueillies avec enthousiasme, ont finalement été régulées ou interdites lorsque leurs effets néfastes sont devenus évidents. Les CFC (chlorofluorocarbures) qui détruisaient la couche d’ozone ont été bannis. L’amiante, longtemps considéré comme un matériau miracle, est aujourd’hui interdit dans la plupart des pays.

La position radicale d’une interdiction des IA génératives créatives et intellectuelles se justifie par plusieurs arguments de fond. D’abord, ces outils menacent directement des facultés humaines essentielles : la créativité, l’expression personnelle, la capacité de réflexion autonome. Ces facultés ne sont pas de simples commodités, elles définissent notre humanité même.

Ensuite, contrairement à d’autres technologies dont les bénéfices compensent clairement les inconvénients, les IA génératives présentent un bilan coûts-avantages discutable. Oui, elles font gagner du temps et facilitent certaines tâches. Mais ce gain d’efficacité vaut-il l’atrophie progressive de nos capacités cognitives et créatives ? Vaut-il la standardisation de nos expressions ? Vaut-il l’évacuation des relations humaines dans de nombreux domaines ?

L’argument selon lequel « la technologie est neutre et seul l’usage compte » ne tient pas face aux IA génératives. Ces outils sont conçus précisément pour se substituer à des activités humaines intellectuelles et créatives. Leur architecture même encourage la délégation et décourage l’effort personnel. Il ne s’agit pas d’un détournement d’usage, mais de leur fonction première.

Une interdiction ne signifierait pas nécessairement l’élimination totale de toute forme d’IA. Elle pourrait cibler spécifiquement les applications qui remplacent directement des tâches intellectuelles et créatives humaines, tout en préservant les usages véritablement bénéfiques de l’intelligence artificielle.

La faisabilité politique d’une telle mesure semble certes compromise à court terme. Mais l’urgence de la situation pourrait évoluer rapidement. Si les effets délétères des IA génératives deviennent suffisamment manifestes et préoccupants, un mouvement d’opinion pourrait émerger en faveur d’une régulation stricte, voire d’une interdiction.

Distinguer les IA bénéfiques des IA destructrices

Toutes les intelligences artificielles ne se valent pas sur le plan éthique et social. Il est crucial d’établir une distinction claire entre les applications véritablement utiles de l’IA et celles qui menacent nos facultés humaines fondamentales.

Les IA bénéfiques sont celles qui augmentent nos capacités sans se substituer à nos facultés essentielles. L’IA médicale qui aide les radiologues à détecter des tumeurs plus rapidement en fait partie. Elle ne remplace pas le jugement clinique du médecin, elle lui fournit un outil d’aide à la décision qui améliore la qualité des diagnostics.

De même, l’IA utilisée en aéronautique pour optimiser les trajectoires de vol ou améliorer la sécurité des avions représente un usage positif. Ces applications résolvent des problèmes techniques complexes sans éroder les compétences humaines fondamentales. Le pilote conserve son expertise et sa responsabilité finale.

En revanche, les IA génératives créatives et intellectuelles appartiennent à une catégorie différente. Elles ne se contentent pas d’assister l’humain dans une tâche : elles effectuent la tâche à sa place. Lorsque ChatGPT rédige un article entier, lorsque Midjourney crée une illustration complète, lorsque Suno compose une chanson, ces outils ne « aident » pas l’humain – ils le remplacent.

Cette distinction n’est pas toujours évidente à établir. Certaines applications se situent dans une zone grise. Par exemple, une IA qui suggère des formulations alternatives pendant qu’on écrit peut être considérée comme un outil d’assistance. Mais si cette assistance devient si prégnante qu’on finit par ne plus formuler ses propres phrases, elle bascule dans la substitution.

Le critère déterminant pourrait être : l’outil préserve-t-il et encourage-t-il l’exercice actif des facultés humaines, ou les court-circuite-t-il ? Une calculatrice nous évite les calculs fastidieux mais n’empêche pas de comprendre les mathématiques. Une IA qui rédige à notre place nous prive de l’exercice même de la pensée et de l’expression.

Questions fréquemment posées (FAQ)

Quels sont les principaux dangers de l’intelligence artificielle générative ?

Les principaux risques incluent l’atrophie de nos facultés créatives et intellectuelles par manque d’exercice, la standardisation de l’expression humaine au détriment de notre singularité, la perte progressive de la maîtrise du langage qui structure notre pensée, l’évacuation des relations humaines dans de nombreux domaines professionnels, et la création d’une dépendance technologique qui nous infantilise. Ces dangers dépassent largement la simple question du remplacement des emplois pour toucher à notre essence même en tant qu’êtres pensants et créatifs.

Comment l’IA générative affecte-t-elle notre créativité personnelle ?

L’utilisation régulière d’IA génératives crée une forme d’atrophie créative similaire à celle décrite dans la fable du rossignol philomène. Lorsque nous déléguons systématiquement nos tâches créatives à des algorithmes, nous privons notre cerveau de l’exercice nécessaire au maintien de nos capacités imaginatives. La créativité, comme un muscle, nécessite un entraînement constant. Les neurosciences montrent que le processus créatif active des réseaux neuronaux complexes qui s’affaiblissent s’ils ne sont plus sollicités régulièrement.

Quelle est la différence entre IA générative et IA utile ?

Une IA utile assiste l’humain dans l’accomplissement d’une tâche complexe sans la réaliser entièrement à sa place, comme l’IA médicale qui aide au diagnostic ou l’IA aéronautique qui optimise la sécurité. Une IA générative, en revanche, se substitue complètement à l’activité intellectuelle ou créative humaine en produisant des contenus originaux (textes, images, musiques) qui auraient normalement requis l’intervention directe d’un créateur humain. La première augmente nos capacités, la seconde les remplace et risque de les atrophier.

Comment protéger les enfants de la dépendance à l’IA générative ?

La protection commence par l’éducation : expliquer aux enfants pourquoi l’effort intellectuel personnel reste précieux malgré l’existence des IA. Il faut établir des règles claires d’usage, privilégier l’apprentissage traditionnel des compétences fondamentales (écriture, calcul, créativité) avant d’introduire des outils d’assistance. Les parents et enseignants doivent montrer l’exemple en limitant leur propre dépendance aux IA. Enfin, valoriser l’imperfection et le processus d’apprentissage plutôt que seulement le résultat final aide les enfants à comprendre que les erreurs font partie intégrante du développement de leurs facultés.

Que signifie « l’atrophie créative » causée par l’IA ?

L’atrophie créative désigne l’affaiblissement progressif de nos capacités d’imagination, d’innovation et d’expression personnelle résultant de la sous-utilisation de ces facultés. Comme un muscle qui s’affaiblit sans exercice, notre créativité nécessite une pratique régulière pour se maintenir et se développer. Lorsque nous déléguons systématiquement nos tâches créatives à des IA génératives, nous privons notre cerveau des stimulations nécessaires au maintien de ces compétences. Cette atrophie se manifeste par une perte de confiance en nos propres capacités créatives et une dépendance croissante aux solutions générées par algorithmes.

Comment utiliser l’IA de manière éthique et responsable ?

Un usage éthique de l’IA implique de la considérer comme un outil d’assistance ponctuelle plutôt qu’un substitut permanent à nos facultés. Cela signifie faire l’effort de formuler d’abord ses propres idées avant de solliciter l’IA pour des améliorations mineures, limiter son utilisation aux tâches véritablement répétitives ou à faible valeur créative, maintenir une pratique régulière de création autonome pour préserver ses compétences, être transparent sur l’usage de l’IA dans ses productions, et questionner systématiquement la nécessité de recourir à ces outils plutôt que de céder à la facilité. L’objectif est de rester maître de ses facultés plutôt que d’en devenir dépendant.

Conclusion : vers une mobilisation citoyenne

L’heure n’est plus à l’admiration béate devant les prouesses technologiques des IA génératives. Elle est à la lucidité et à la mobilisation. Trois ans après l’arrivée fracassante de ChatGPT, nous disposons d’un recul suffisant pour évaluer les dégâts et tirer la sonnette d’alarme.

Le constat est sévère. Nous assistons à une érosion progressive mais réelle de nos facultés intellectuelles et créatives. L’atrophie créative, l’évacuation d’autrui, la perte de singularité humaine, la standardisation de l’expression : ces dangers ne relèvent plus de la spéculation futuriste mais de l’observation documentée.

La faillite collective face aux IA génératives s’explique par notre incapacité à poser la question morale fondamentale : devions-nous vraiment autoriser ces technologies ? Au lieu de ce débat nécessaire, nous avons collectivement sauté sur l’opportunité du moindre effort et du gain de temps immédiat.

Mais il n’est pas trop tard pour réagir. La mobilisation peut prendre plusieurs formes. Au niveau individuel, chacun peut décider de limiter drastiquement son usage des IA génératives créatives et intellectuelles. Choisir l’effort plutôt que la facilité, préserver ses facultés par un exercice régulier, valoriser l’imperfection et le processus créatif personnel.

Au niveau collectif, nous devons exiger de nos représentants une régulation stricte, voire une interdiction des applications les plus dangereuses. Le débat démocratique qui aurait dû précéder le déploiement de ces technologies doit maintenant avoir lieu. Quelles limites voulons-nous établir ? Quelles utilisations accepter et lesquelles proscrire ?

Les enseignants, les parents, les créateurs, les travailleurs intellectuels : nous sommes tous concernés. L’avenir de notre humanité pensante et créative se joue maintenant. Nos enfants nous demanderont bientôt : « Pourquoi apprendre alors que l’IA fait tout ? » Notre réponse déterminera le monde dans lequel ils grandiront.

Accepterons-nous de devenir des spectateurs atrophiés dans notre nid confiné, ou choisirons-nous de préserver et exercer nos facultés essentielles ? La réponse n’appartient pas aux entreprises technologiques. Elle nous appartient collectivement.

La mobilisation commence aujourd’hui. Par nos choix individuels, nos exigences politiques, notre refus de la facilité trompeuse. Parce qu’au-delà de l’efficacité et du gain de temps, c’est notre essence même qui est en jeu.